8-jährige Entwicklungsgeschichte der KI-Gesichtstauschtechnik „Deepfakes“

KI-generierte gefälschte Bilder und Videos, auch Deepfakes genannt, haben in den letzten Jahren einen Hochpunkt der Entwicklung erreicht. In diesem Artikel untersuchen wir diese Geschichte und blicken zurück auf die einzelnen wichtigen Meilensteine.

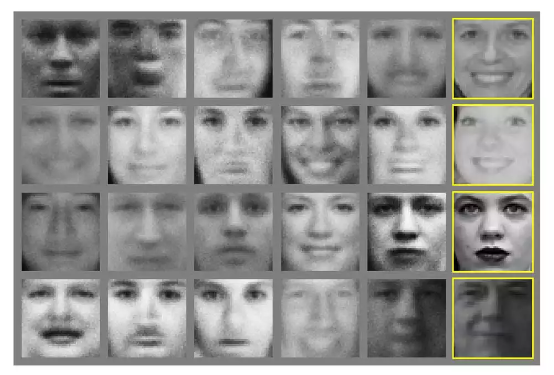

Was verbindet die Gesichter im obigen Bild? Die Antwort: Nichts. Sie sind alle vollständig von KI erzeugt. Genauer gesagt: Die KI lernt aus Millionen von Pixelbildern und erstellt am Ende Ergebnisse, die kaum noch von echten Bildern zu unterscheiden sind.

Die Technologie der Generativen Adversarial Networks (GAN)

Hinter diesen hochwertigen gefälschten Bildern steht die Technologie der „Generativen Adversarial Networks“ (GAN). Solche Netzwerke bestehen aus zwei KI-Agenten: Einer erstellt gefälschte Bilder, der andere prüft, ob ein Bild echt ist. Stellt der Prüfer-Agent eine Fälschung fest, verbessert die erstellende KI weiter.

Auf diese Weise entwickeln beide Agenten im Training immer stärkere Fähigkeiten. Am Ende kann die erstellende KI somit fiktive Bilder erzeugen, die Menschen kaum noch von echten unterscheiden können.

Nicht jedes GAN ist gleich

In der Praxis unterscheiden sich die Ergebnisse des ursprünglichen GAN stark von denen heutiger GAN-Varianten.

Ian Goodfellow und die Entwicklung von GAN

Ian Goodfellow, der gerade zum KI-Chef von Apple ernannt wurde, veröffentlichte auf Twitter einen Artikel über die Entwicklung der Deepfake-Technologie in den vergangenen Jahren. Goodfellow ist kein Geringerer – er ist der anerkannte Erfinder des GAN-Prinzips.

Ein Rückblick auf viereinhalb Jahre Fortschritt bei der Gesichtserstellung durch GAN:

Kurze Entwicklungsgeschichte von GAN

Schaut man sich die wissenschaftlichen Arbeiten in Goodfellows Link an, wird klar, wie sich Deepfake-Technologie dank neuer KI-Architekturen, großer Datensätze und immer stärkerer Rechenleistung Schritt für Schritt rasant entwickelt hat:

2014: Das Geburtsjahr von Deepfake

Goodfellow und seine Kollegen veröffentlichten die weltweit erste wissenschaftliche Arbeit, die GAN vorstellt – damit wurde der GAN-KI geboren. Erst durch GAN entstanden nach und nach die heute bekannten Deepfakes.

Bereits 2014 gab es Anzeichen dafür, dass GAN in der Lage sein könnte, sehr realistische Gesichter zu erzeugen.

2015: GAN wird besser

Forscher begannen, GAN mit mehrschichtigen Convolutional Neural Networks (CNN) zu kombinieren, die für die Bilderkennung optimiert sind. CNNs können große Datenmengen parallel verarbeiten und laufen besonders effizient auf Grafikkarten. Diese Kombination löste die früher einfacheren GAN-Agenten-Netzwerke ab und brachte die Glaubwürdigkeit der Ergebnisse auf ein neues Niveau.

Je komplexer die Struktur des Convolutional Networks, desto überzeugender die erzeugten gefälschten Gesichter. Im Jahr 2015 gab es jedoch noch keine wirklich fotorealistischen Bilder.

2016: Deepfake-Brillen und Gesichtsverarbeitung

Forscher kombinierten zwei GANs: Die Agenten verschiedener Netzwerke konnten Informationen untereinander teilen. Auf diese Weise lernten sie parallel voneinander.

Jeder Agent veränderte die Trainingsdaten leicht. Einer konnte beispielsweise Gesichter mit Sonnenbrille und ohne Sonnenbrille erstellen. Die Gesichter wurden bereits überzeugender, doch der Eindruck „offensichtlich gefälscht“ blieb noch bestehen.

Mithilfe gekoppelter GANs konnten gefälschte Personen nun Sonnenbrillen oder Schmuck tragen. Dennoch wiesen diese Gesichter noch viele Fehler auf – das Problem der offensichtlichen Fälschung blieb.

2017: Nvidia treibt den Qualitätssprung voran – das erste Deepfake-Video entsteht

Forscher von Nvidia lösten ein zentrales Problem früherer GANs und erzielten damit einen massiven Qualitätssprung:

Je niedriger die Bildauflösung, desto schwerer fällt es dem Prüf-Agenten, eine Fälschung zu erkennen. Daher neigte der erstellende Agent dazu, unscharfe Bilder zu produzieren – je unschärfer, desto weniger Fehler. Die KI verhält sich also ziemlich schlau.

Nvidia lieferte die Lösung: Das Netzwerk wird stufenweise trainiert. Zuerst lernt die gefälschende KI, Bilder in niedriger Auflösung zu erstellen. Danach wird die Auflösung nach und nach erhöht.

So wird das GAN schrittweise zur Erstellung hochauflösender Bilder befähigt.

Auf diese Weise entwickelte sich ein GAN, das bisher unerreichte gefälschte Porträts erzeugte. Obwohl die Bilder noch Fehler aufwiesen, waren sie ohne genaue Prüfung kaum noch von echten zu unterscheiden.

Die 2017 erzeugten Gesichter übertrafen alle vorherigen Standards – einige waren bereits kaum noch von echten zu unterscheiden.

Während Nvidia weiterhin an seinem GAN feilte, brachte der Reddit-Nutzer „deepfakes“ die Technik in die Öffentlichkeit. Im Herbst 2017 erschien das erste pornografische Bild unter dem Namen „deepfakes“, bei dem das Gesicht einer Pornodarstellerin durch das einer anderen bekannten Frau ersetzt wurde.

Die Probleme durch missbräuchliche pornografische Nutzung

Seitdem wurde der Begriff Deepfake zum Synonym für KI-generierte Bilder und Videos. Das „deep“ steht für die vielen Zwischenschichten in neuronalen Netzen – also die Bildgenerierung durch Deep Learning.

Deepfake-Pornovideos hatten zwar noch deutliche Erkennungsmerkmale, aber sie ließen sich extrem kostengünstig erstellen. Daher strömten schnell tausende Nutzer auf Plattformen wie Reddit, um diese expliziten und seltsam wirkenden Videos anzusehen. Die US-Schauspielerin Scarlett Johansson wurde zu einem häufigen Opfer in KI-Pornofilmen – später wurde dieser Internet-Trend als „dunkles Wurmloch“ bezeichnet.

2018: Bessere Kontrolle über GAN – Deepfake auf YouTube

Als Reaktion darauf verbesserten Nvidia-Forscher die Kontrolle über GAN erneut: Sie konnten einzelne Bildmerkmale gezielt anpassen, beispielsweise „schwarze Haare“ oder „Lächeln“ bei einem Porträt.

Auf diese Weise konnten Merkmale aus Trainingsbildern gezielt auf KI-generierte Bilder übertragen werden. Diese Methode heißt „Style Transfer“ und wurde zu einem wichtigen Bestandteil vieler nachfolgender KI-Forschungsprojekte.

Style Transfer erlaubt die Steuerung der Bild-KI – beispielsweise zur Erstellung nur lächelnder Porträts.

Natürlich funktioniert das GAN-Prinzip nicht nur für Gesichter. Die KI interessiert sich nicht für die Art der Pixelstruktur, die sie erzeugt – sie braucht nur passende Trainingsdaten. Ende 2018 zeigte der KI-Riese Deepmind KI-generierte Bilder von Essen, Landschaften und Tieren, die extrem realistisch und beeindruckend wirkten.

Die Software Deep Video Portrait versuchte, die Videoverarbeitung mit GAN zu verbessern. Damit ging der erste YouTube-Kanal zu Deepfakes an den Start: Es handelte sich nicht mehr nur um gefälschte Pornofilme, sondern um „veränderte“ Versionen von Politikern und Hollywood-Stars. Ab da diskutierte man, ob KI verstorbene Schauspieler „wieder zum Leben erwecken“ könnte.

Gleichzeitig ging der Trend der Deepfake-Pornografie zurück: Im ersten Quartal 2018 verboten Plattformen wie Pornhub, Twitter, Gfycat und Reddit solche Videos. Viele gängige Webseiten zu Deepfake-Apps wurden ebenfalls offline genommen.

FaceShifter (rechts außen) konnte sogar unscharfe Originalbilder zu überzeugenden Fälschungen verarbeiten – besser als der bisher stärkste Deepfake-Algorithmus FSGAN (zweites Bild von rechts).

Sehr gute Deepfake-Ergebnisse – sogar Disney nutzt sie

Der Unterhaltungsriese Disney begann mit der Entwicklung von Deepfake-Technologie für die Filmproduktion und schuf damit das erste Deepfake-Tool in Megapixel-Qualität. Es erzeugt Bilder mit 1024 x 1024 Pixeln – ein Patent, das vergleichbare Tools wie DeepFaceLab mit armseligen 256 x 256 Pixeln in den Schatten stellt. Selbst Anfang 2021 unterstützte DeepFaceLab 2.0 nur maximal 448 x 448 Pixel.

Langfristig könnte Disneys Deepfake-Technologie herkömmliche Spezialeffekte ablösen und die Situation beenden, in der einige Sekunden Bild monatelange Rendering-Arbeit erfordern.

Disney-Fans erwarten die Technik gespannt. Die kürzlich gestartete Star-Wars-Serie „The Mandalorian“ nutzte die neue Megapixel-Deepfake-Funktion noch nicht – aber auf YouTube lieferten Deepfake-Videos zu denselben Szenen bereits bessere Ergebnisse als Disneys CGI-Künstler.

2021: Deepfake-Tourneen, Live-Streaming und Gesichtsvermietung

Das Jahr begann mit einem Deepfake-Video von Tom Cruise. Dieses erstmals auf TikTok veröffentlichte Video war so realistisch, dass man nur bei sorgfältiger Prüfung Fehler erkennen konnte. Die überzeugende Wirkung sorgte für virale Verbreitung – der zugehörige Kanal „Deeptomcruise“ gewann schnell Hunderttausende Follower und große Aufmerksamkeit unter Tom-Cruise-Fans. Erstellt wurde der Kanal vom VFX-Experten Chris Umé, der angab, dass jedes Video Wochen Arbeit kostete.

Kurze Zeit später eroberte die App Wombo AI das Netz: Mit wenigen Klicks konnte man jedes Personenfoto zu einem kurzen Video verwandeln, in dem die Person bekannte Lieder singt. Wombo AI lernt aus aufgenommenen Videos echter Künstler und passt dann das Gesicht des Fotos an die Mimik des ursprünglichen Sängers an.

WOMBO AI ist einfach genial, haha

Disney stellte zudem einen bekannten Deepfake-YouTuber ein – Gerüchte besagten, dass zukünftig weitere Deepfake-Figuren in seinen Filmen und Serien auftauchen würden. Tatsächlich bestätigte die Ende 2021 erschienene Serie „The Book of Boba Fett“ diese Vermutungen.

Deepfakes in sozialen Medien und Massenmedien

Neben Disney tauchte das Gesicht von Bruce Willis in einer russischen Handelswerbung auf. Ein Startup kaufte die Rechte an seinem echten Gesicht und nutzte Deepfake-Technologie, um daraus Werbeinhalte zu erstellen. Nvidia veröffentlichte 2021 zudem Alias-Free GAN, eine verbesserte Version von StyleGAN2, die einheitlichere Ergebnisse bei sich ändernden Blickwinkeln liefert. Monate später folgte die optimierte Version StyleGAN3.

Der Entwickler von DeepFaceLab zeigte 2021 erstmals DeepFaceLive. Dieses Programm kann nach entsprechender Schulung oder mit vortrainierten KI-Modellen Gesichter in Echtzeitvideos austauschen. Für diese Echtzeit-Gesichtstausch-Funktion benötigt man jedoch eine High-End-Grafikkarte, wie sie für aktuelle AAA-Spiele verwendet wird.

2021 holten zudem erstmals sogenannte Diffusionsmodelle in der Bildqualität zu den bis dahin dominanten GANs auf. Obwohl diese Technik noch nicht für Deepfake verwendet wurde, bildete sie die Grundlage für OpenAIs Bildgenerierungstool GLIDE, das Ende 2021 erschien.

2022: 3D-GAN, DALL-E 2 und der Deepfake von Selenskyj

Im Januar dieses Jahres folgten zwei weitere beeindruckende Verbesserungen von GAN. KI-Forscher der Universität Tel Aviv präsentierten eine Variante von StyleGAN2, die Gesichter in kurzen Videosequenzen einfach manipulieren konnte – beispielsweise zum Lächeln bringen oder abmagern – und das ohne zusätzliches Training.

Forscher von Nvidia und der Stanford University zeigten, wie effiziente geometrisch bewusste 3D-Generative Adversarial Networks (EG3D) realisiert werden können. Damit kann die KI aus verschiedenen Blickwinkeln konsistente 3D-Bilder von Personen (oder Kätzchen) erstellen.

Entsprechend kann 3D-GAN aus einem einzigen echten Bild ein 3D-Modell rekonstruieren. Daher wirken die von EG3D erzeugten Fälschungen noch realistischer, da die Personen aus unterschiedlichen Perspektiven konsistent bleiben.

2022 entdeckten Forscher des Stanford Internet Observatory in einer zweiwöchigen Studie über 1000 verdächtige gefälschte Profile bei LinkedIn. Über 70 Unternehmen bestätigten diese gefälschten Profile als echte Personen – meist als vielversprechende potenzielle Kunden. Bei erfolgreichem Kontakt trat dann eine echte Person auf, die im Namen der gefälschten Figur weiterkommunizierte.

Im jüngsten global beachteten Konflikt zwischen der Ukraine und Russland ereignete sich zudem ein historisches Deepfake-Ereignis.

In dem Video rief der gefälschte ukrainische Präsident Selenskyj das Volk auf, die Waffe niederzulegen. Obwohl das Video eine geringe Auflösung hatte und schlecht gefälscht war, hatte es kaum Wirkung. Bisher gibt es keinen nachweisbaren Beweis, dass es sich um ein KI-generiertes Video handelt – aber viele Medien und Experten gehen mit hoher Wahrscheinlichkeit von einem Deepfake aus.

Im April 2022 stellte OpenAI DALL-E 2 vor – ein KI-System, das Bilder anhand von Textbeschreibungen erstellt. Die vollständige Version des Projekts sollte im Sommer 2022 veröffentlicht werden.

DALL-E 2 und das zugrundeliegende Diffusionsmodell wurden nicht für Deepfake verwendet. OpenAI verbietet ausdrücklich die Erstellung von Gesichtern mit dieser Technik. Dennoch wird diese Technologie in Zukunft die Qualität synthetischer Bilder weiter verbessern.

Zusammenfassung

Als GAN-Erfinder Goodfellow 2014 seine Arbeit erstmals vorstellte, ahnte er sicher nicht, dass sie die rasante Entwicklung von KI-Fälschungen vorantreiben würde. Heute warnt er selbst: In Zukunft werden Menschen Bilder und Videos im Internet nicht mehr selbstverständlich als echt ansehen können.

Am Ende könnten selbst ausgefeilte Anti-Deepfake-Algorithmen die neuesten Deepfake-Ergebnisse nicht mehr erkennen – und das wird Bereiche wie Soziales, Unterhaltung und viele weitere revolutionär verändern. Deepfake-Experte Hao Li hält diese Vermutung für keineswegs überzogen. Schließlich sind Bilder am Ende nur Pixel mit passenden Farben – es ist nur eine Frage der Zeit, bis die KI die perfekte Anordnung findet.

Zudem haben Deepfakes durch die rasante Verbreitung auf Plattformen wie YouTube, Reface oder Impressions schnell Einzug in unseren Alltag gehalten. Früher haben Menschen noch ohne Fotos und Videos gelernt, Informationen zu erhalten und Meinungen zu bilden. Doch diese Tür zum Licht scheint durch neue Technologien verschlossen zu werden. Goodfellow resümierte: "Aus dieser Sicht betrachtet könnte die KI gerade dabei sein, die Augen unserer Generation zu verdunkeln."