Les « Deepfakes » en 8 ans : une brève histoire de l’évolution

Les images et vidéos générées par l’IA, ou deepfakes, ont connu un fort développement ces dernières années. Dans cet article, nous retraçons cette histoire et les étapes marquantes.

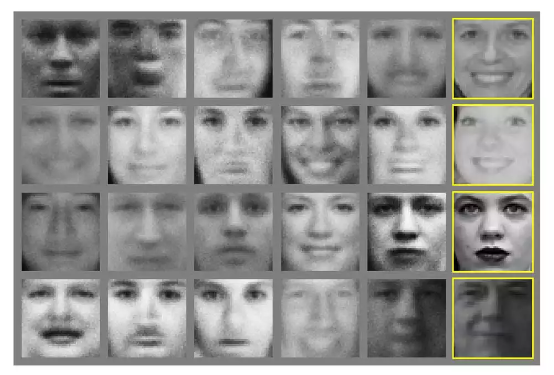

Qu’ont en commun les visages de l’image ci-dessus ? Rien. Ils ont tous été inventés par l’IA — ou plus précisément, appris par l’IA à partir de millions d’images, puis synthétisés en résultats difficiles à distinguer du réel.

La technologie des réseaux antagonistes génératifs (GAN)

Derrière ces images de synthèse de qualité se trouve la technologie des « réseaux antagonistes génératifs » (GAN). Ces réseaux comprennent deux agents : l’un génère des images fausses, l’autre juge si une image est réelle. Quand le discriminateur repère un faux, le générateur s’améliore.

Ainsi, les deux agents deviennent plus performants pendant l’entraînement. À terme, le générateur peut produire des images de synthèse que l’humain distingue à peine du réel.

Tous les GAN ne se valent pas

En pratique, les sorties du GAN originel et des variantes actuelles sont très différentes.

Ian Goodfellow et le développement des GAN

Ian Goodfellow, récemment nommé responsable IA chez Apple, a un jour posté sur Twitter sur l’évolution de la technologie deepfake. Il est considéré comme l’inventeur du procédé GAN.

Voici comment les GAN ont progressé en génération de visages sur ces quatre ans et demi :

Brève histoire des GAN

Les articles cités par Goodfellow montrent comment la technologie deepfake a progressé grâce aux nouvelles architectures IA, aux jeux de données à grande échelle et à une puissance de calcul accrue.

2014 : l’année de naissance du deepfake

Goodfellow et ses collègues ont publié le premier article scientifique présentant les GAN, marquant la naissance de l’IA GAN. Ce sont les GAN qui ont conduit aux deepfakes que nous connaissons aujourd’hui.

Dès 2014, des signes montraient que les GAN pouvaient générer des visages très réalistes.

2015 : les GAN passent au niveau supérieur

Les chercheurs ont commencé à combiner les GAN avec des réseaux de neurones convolutifs (CNN) optimisés pour la reconnaissance d’images. Les CNN traitent de grandes quantités de données en parallèle et s’exécutent très bien sur GPU. Cette combinaison a remplacé les réseaux GAN plus simples et a porté la crédibilité des résultats générés à un nouveau niveau.

Plus le réseau convolutif est complexe, plus les visages de synthèse sont convaincants. Mais en 2015, les images photoréalistes n’existaient pas encore.

2016 : lunettes deepfake et manipulation du visage

Les chercheurs ont couplé deux GAN pour que les agents de réseaux différents partagent des informations et apprennent en parallèle.

Chaque agent modifiait légèrement les données d’entraînement. Par exemple, l’un pouvait générer des visages avec ou sans lunettes de soleil. Les visages générés étaient déjà plus crédibles, mais les résultats « clairement faux » restaient fréquents.

Avec les GAN couplés, les visages de synthèse pouvaient porter des lunettes ou des bijoux, mais les visages eux-mêmes gardaient beaucoup de défauts.

2017 : le bond qualitatif de NVIDIA et la première vidéo deepfake

Les chercheurs de NVIDIA ont traité une limite majeure des GAN précédents et réalisé un bond qualitatif :

Plus la résolution était basse, plus le discriminateur avait du mal à distinguer le vrai du faux, donc les générateurs tendaient à produire des images floues. L’IA s’est révélée plutôt rusée.

La solution de NVIDIA a été d’entraîner le réseau par étapes : d’abord le générateur apprend à créer des images basse résolution, puis la résolution est progressivement augmentée.

Les GAN ont ainsi gagné peu à peu une capacité de génération en haute résolution.

Les GAN entraînés ainsi ont commencé à produire des visages de synthèse d’une qualité inédite. Encore imparfaits, ils étaient déjà difficiles à distinguer au premier coup d’œil.

Les visages générés en 2017 dépassaient largement ce qui existait avant ; certains étaient vraiment difficiles à distinguer du réel.

Alors que NVIDIA poursuivait ses améliorations, l’utilisateur Reddit « deepfakes » popularisait la technologie. À l’automne 2017 est apparue la première image nommée « deepfakes » — une image pornographique remplaçant le visage d’une actrice par celui d’une célébrité.

Les dérives de l’usage pornographique

Depuis, « deepfake » est devenu un terme générique pour les images et vidéos générées par l’IA. Le « deep » renvoie aux nombreuses couches du réseau de neurones — l’apprentissage profond pour la synthèse d’images.

Le deepfake pornographique avait aussi de sérieux problèmes de « clairement faux », mais avec un coût de production très bas, des millions d’utilisateurs ont afflué sur Reddit et d’autres plateformes. Des visages de célébrités comme Scarlett Johansson ont été souvent utilisés, dans ce qu’on a appelé un « trou noir » du web.

2018 : meilleur contrôle des GAN et deepfake sur YouTube

Dans cette vague, les chercheurs NVIDIA ont encore amélioré le contrôle des GAN : ils pouvaient modifier des attributs isolés, comme « cheveux noirs » ou « sourire » sur un portrait.

Cela a permis de transférer de façon ciblée des traits des images d’entraînement vers les images générées par l’IA. L’approche a été nommée « transfert de style » et est devenue centrale dans de nombreux projets IA.

Le transfert de style permettait de piloter l’IA d’images — par exemple, ne générer que des visages souriants.

Les GAN ne se limitent bien sûr pas aux visages ; l’IA ne se soucie pas des pixels qu’elle produit, seulement des données d’entraînement. Fin 2018, DeepMind a montré des aliments, paysages et animaux générés par l’IA d’une impressionnante réalisme.

Deep Video Portrait a utilisé les GAN pour améliorer le traitement vidéo, et la première chaîne YouTube dédiée aux deepfakes est apparue : plus seulement du faux pornographique, mais des politiques et stars hollywoodiennes « deepfake ». On a commencé à se demander si l’IA pouvait « ressusciter » des acteurs disparus.

Dans le même temps, le deepfake pornographique a commencé à reculer : au premier trimestre 2018, Pornhub, Twitter, Gfycat et Reddit ont banni ce contenu. De nombreux sites d’applications deepfake ont fermé.

FaceShifter (image la plus à droite) pouvait transformer des images sources floues en faux plausibles, surpassant l’algorithme deepfake alors dominant, FSGAN (deuxième en partant de la droite).

Les deepfakes fonctionnent bien — Disney s’y met aussi

Le géant du divertissement Disney a commencé à développer la technologie deepfake pour le cinéma, et le premier outil deepfake à l’échelle du mégapixel est né, générant des images 1024×1024 — bien au-delà des 256×256 d’outils comme DeepFaceLab. Même début 2021, DeepFaceLab 2.0 plafonnait à 448×448.

À long terme, la technologie deepfake de Disney pourrait remplacer les pipelines VFX traditionnels et éviter les mois de rendu pour de courts extraits.

Les fans Disney l’attendent. La série Star Wars The Mandalorian n’utilisait pas encore la fonction deepfake mégapixel, mais des deepfakes de fans sur YouTube rivalisaient déjà avec le CGI de Disney.

2021 : tournées deepfake, directs et licence de visage

L’année a commencé avec une vidéo deepfake de Tom Cruise. Sa première sur TikTok était si convaincante qu’il fallait une analyse attentive pour voir les défauts. Elle est devenue virale et la chaîne « Deeptomcruise » a rapidement gagné des centaines de milliers d’abonnés. Le créateur Chris Umé, spécialiste des effets visuels, a indiqué que chaque vidéo prenait des semaines.

Peu après, l’appli Wombo AI a fait sensation : en quelques taps, n’importe quelle photo pouvait devenir une courte vidéo de la personne chantant une chanson célèbre. Wombo apprenait à partir de vrais interprètes et calait le visage de la photo sur les expressions du chanteur original.

WOMBO AI est vraiment impressionnant.

Disney a aussi embauché un YouTuber deepfake connu, alimentant les spéculations sur l’apparition de plus de personnages deepfake dans ses séries. La sortie fin 2021 de The Book of Boba Fett en a confirmé une partie.

Les deepfakes dans les médias sociaux et de masse

Outre Disney, le visage de Bruce Willis est apparu dans une pub russe. Une startup a licencié son image et a utilisé la technologie deepfake pour la campagne. NVIDIA a publié Alias-Free GAN en 2021, une version améliorée de StyleGAN2 avec des résultats plus cohérents selon l’angle. Quelques mois plus tard, StyleGAN3 est sorti.

Les créateurs de DeepFaceLab ont présenté DeepFaceLive en 2021. Avec un entraînement adapté ou des modèles pré-entraînés, il pouvait échanger des visages en vidéo en temps réel — mais nécessitait une carte graphique haut de gamme.

En 2021, les modèles dits de diffusion ont pour la première fois égalé la qualité d’image des GAN. Pas encore utilisés pour le deepfake, ils ont néanmoins servi de base au générateur d’images GLIDE d’OpenAI fin 2021.

2022 : GAN 3D, DALL-E 2 et le deepfake Zelensky

En janvier, deux avancées GAN notables ont vu le jour. Des chercheurs de Tel Aviv ont présenté une variante de StyleGAN2 capable de manipuler facilement des visages dans de courts clips — sourire, amaigrissement du visage — sans entraînement supplémentaire.

Des chercheurs de NVIDIA et Stanford ont présenté EG3D (Efficient Geometry-aware 3D GAN), permettant à l’IA de générer des images cohérentes de type 3D de personnes (ou de chats) sous différents angles.

Inversement, les GAN 3D pouvaient reconstruire des modèles 3D à partir d’une seule image réelle. Les faux EG3D étaient donc plus convaincants car cohérents selon la vue.

En 2022, des chercheurs du Stanford Internet Observatory ont trouvé plus de 1 000 profils faux suspects sur LinkedIn en deux semaines. Plus de 70 entreprises les avaient vérifiés comme réels ; beaucoup étaient traités comme prospects prometteurs. Quand la prise de contact aboutissait, un humain prenait le relais sous l’identité fictive.

Le conflit russo-ukrainien a aussi produit un moment deepfake historique.

Une vidéo montrait un Zelenskyy de synthèse exhortant les Ukrainiens à déposer les armes. Une faible résolution et une qualité médiocre ont limité l’impact. Il n’y a pas de preuve définitive que ce soit de l’IA, mais de nombreux médias et experts l’ont considéré comme un deepfake.

En avril 2022, OpenAI a lancé DALL-E 2, un système qui génère des images à partir de texte. Le déploiement complet était prévu pour l’été 2022.

DALL-E 2 et ses modèles de diffusion n’ont pas été utilisés pour le deepfake, et OpenAI interdit explicitement la génération de visages. La technologie n’en élèvera pas moins le niveau des images de synthèse.

Résumé

Quand l’inventeur des GAN, Goodfellow, a présenté son travail en 2014, il ne s’attendait probablement pas à ce qu’il alimente une telle progression des images générées par l’IA. Il a depuis averti qu’à l’avenir, on ne pourra plus se fier aux images et vidéos vues sur internet.

À terme, même les meilleurs algorithmes anti-deepfake pourraient ne plus détecter les derniers faux, avec des effets disruptifs dans le social, le divertissement et ailleurs. Le chercheur Hao Li a dit que ce n’est pas exagéré : une image n’est que des pixels avec les bonnes couleurs — l’IA pourrait bien trouver la disposition parfaite. C’est une question de temps.

Alors que les deepfakes se propagent sur YouTube, Reface, Impressions et ailleurs, l’image de synthèse va imprégner le quotidien. Les humains ont appris à se faire une opinion à une époque sans vidéo ni photo ; cette clarté pourrait désormais être obscurcie par la nouvelle technologie. Comme l’a dit Goodfellow : « En ce sens, l’IA pourrait bien aveugler notre génération sur le monde. »