Historia evolutiva de 8 años de la Deepfake: el intercambio facial por IA

Las imágenes y vídeos falsificados por IA, conocidos como Deepfake, han alcanzado un auge en los últimos años. En este artículo exploramos en profundidad esta historia y repasamos cada uno de sus hitos importantes.

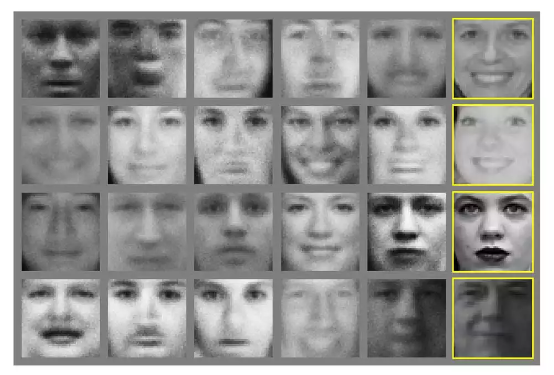

¿Qué tienen en común los rostros de la imagen superior? La respuesta es: nada en común. Todos son creados artificialmente por IA. Más concretamente, la IA aprende a partir de millones de imágenes de píxeles y produce resultados casi indistinguibles de la realidad.

Tecnología de las Redes Antagónicas Generativas (GAN)

Detrás de estas imágenes falsificadas de alta calidad se encuentra la tecnología de las Redes Antagónicas Generativas (GAN). Este tipo de redes está formado por dos agentes de IA: uno se encarga de falsificar imágenes y el otro de detectar si son reales. Si el agente detector identifica la falsificación, la IA generadora mejora su rendimiento.

De esta forma, ambos agentes desarrollan capacidades cada vez más potentes durante el entrenamiento. Así, la IA generadora acaba creando imágenes ficticias que los humanos apenas pueden distinguir de las reales.

No todos los GAN son iguales

En la práctica, los resultados del GAN original son muy diferentes a los de las variantes de GAN actuales.

Ian Goodfellow y el desarrollo de las GAN

Ian Goodfellow, recientemente nombrado responsable de IA en Apple, publicó un artículo en Twitter sobre la evolución de la tecnología deepfake en los últimos años. Goodfellow no es cualquier persona: es el reconocido inventor del proceso GAN.

Repasemos los avances en generación de caras mediante GAN en estos cuatro años y medio:

Breve historia de la evolución de las GAN

Al revisar los artículos académicos del enlace de Goodfellow, se observa claramente cómo la tecnología deepfake ha avanzado rápidamente gracias a la sinergia de nuevas arquitecturas de IA, conjuntos de datos masivos y mayor potencia computacional:

2014: El año de nacimiento de Deepfake

Goodfellow y sus compañeros publicaron el primer artículo científico mundial que presentaba las GAN, lo que supuso el nacimiento de la IA GAN. Fue el surgimiento de las GAN lo que dio paso, paso a paso, a los deepfakes que conocemos hoy en día.

Ya en 2014 hubo indicios de que las GAN podrían generar caras muy realistas.

2015: Las GAN mejoran considerablemente

Los investigadores empezaron a combinar las GAN con redes neuronales convolucionales (CNN) multicapa optimizadas para el reconocimiento de imágenes. Las CNN pueden procesar grandes volúmenes de datos en paralelo y funcionan de forma especialmente eficiente en tarjetas gráficas. Esta combinación reemplazó a las redes de agentes GAN más simples anteriores y elevó la credibilidad de los resultados a un nuevo nivel.

Cuanto más compleja es la estructura de la red convolucional, más creíbles son las caras falsas generadas. Sin embargo, en 2015 aún no aparecieron imágenes de estilo fotorrealista.

2016: Gafas Deepfake y procesamiento facial

Los investigadores combinaron dos GAN: los agentes de diferentes redes podían compartir información entre sí. De esta forma, aprendían en paralelo.

Cada agente modificaba ligeramente los datos de entrenamiento. Por ejemplo, uno de los agentes podía generar caras con gafas de sol y sin gafas de sol. En ese momento, las caras generadas eran ya más creíbles, pero el efecto "falso a simple vista" seguía existiendo.

Gracias a las GAN acopladas, las caras falsas podían llevar gafas de sol o joyas. Pero estos rostros seguían teniendo muchos defectos, y el problema de "ser obviamente falsos" persistía.

2017: Nvidia impulsa un salto cualitativo y aparece el primer vídeo deepfake

Investigadores de Nvidia resolvieron uno de los principales problemas de las GAN anteriores, impulsando un salto cualitativo importante:

Cuanto menor es la resolución de la imagen, más difícil le resulta al agente detector juzgar si el contenido es auténtico. Por ello, el agente generador solía producir imágenes borrosas: cuanto más nítidas, más fácil es cometer errores. Parece que la IA también es bastante astuta.

Nvidia ofreció la solución: entrenar la red por etapas. Primero, la IA falsificadora aprende a crear imágenes de baja resolución. Después, se va aumentando la resolución gradualmente.

Se incorpora paulatinamente la capacidad de generación de alta resolución a la GAN.

De esta forma, la GAN desarrollada comenzó a producir retratos falsos de calidad sin precedentes. Aunque las imágenes aún tenían defectos, sin observarlas detenidamente ya era difícil distinguirlas rápidamente.

Las caras generadas en 2017 superaron con creces los niveles anteriores, y algunas eran ya realmente indistinguibles de las reales.

Mientras Nvidia seguía mejorando su GAN, el usuario de Reddit «deepfakes» empezó a popularizar esta tecnología. En otoño de 2017 vimos la primera imagen pornográfica nombrada como «deepfake», en la que el rostro de una actriz pornográfica era sustituido por el de otra mujer famosa.

El gran problema del abuso pornográfico

Desde entonces, el término deepfake se ha convertido en sinónimo de imágenes y vídeos generados por IA. El «deep» hace referencia a las numerosas capas intermedias de las redes neuronales, es decir, a la generación de imágenes mediante aprendizaje profundo.

Los vídeos pornográficos deepfake también tenían graves problemas de "falsedad evidente", pero al ser extremadamente baratos de producir, miles de usuarios se congregaron rápidamente en plataformas online como Reddit para ver estos vídeos explícitos y algo extraños. La famosa actriz estadounidense Scarlett Johansson se convirtió en un objetivo frecuente en películas pornográficas de IA, y posteriormente se denominó esta tendencia internet como «el agujero negro oscuro».

2018: Mejora el control sobre las GAN y los deepfakes llegan a YouTube

Ante esta oleada, los investigadores de Nvidia volvieron a intervenir para mejorar el control de las GAN: ya podían ajustar características individuales de la imagen de forma específica, como elementos «pelo negro» y «sonrisa» en un retrato.

De esta forma, se podían transferir características de las imágenes de entrenamiento a las imágenes generadas por IA de forma dirigida. Este método se conoce como «transferencia de estilo» y se convirtió en parte importante de muchos proyectos de investigación de IA posteriores.

La transferencia de estilo puede utilizarse para controlar la IA de imágenes, por ejemplo, para crear solo retratos sonrientes.

Por supuesto, el principio GAN no solo es válido para rostros: la IA en sí no le importa qué estructura de píxeles genera, solo necesita los datos de entrenamiento correspondientes. A finales de 2018, el gigante de IA Deepmind mostró imágenes de comida, paisajes y animales generadas por IA, con un contenido visual muy realista e impresionante.

El software Deep Video Portrait intentó mejorar el procesamiento de vídeos mediante GAN, y así nació el primer canal de YouTube dedicado a los deepfakes: ya no solo se trataba de películas pornográficas falsificadas, sino que aparecieron versiones «modificadas» de personajes políticos y grandes estrellas de Hollywood. En ese momento, se empezó a debatir si la IA podría «resucitar» actores ya fallecidos.

Al mismo tiempo, la pornografía deepfake empezó a declive: en el primer trimestre de 2018, plataformas como Pornhub, Twitter, Gfycat y Reddit prohibieron este tipo de vídeos. Muchas webs de aplicaciones deepfake habituales también fueron cerradas.

FaceShifter (imagen más a la derecha) incluso pudo procesar imágenes originales borrosas en falsificaciones creíbles, con mejores resultados que el algoritmo deepfake más potente hasta entonces, FSGAN (segunda imagen desde la derecha).

Los deepfakes funcionan muy bien: incluso Disney los usa

El gigante del entretenimiento Disney comenzó a desarrollar tecnología deepfake para la producción cinematográfica, creando así la primera herramienta deepfake de megapíxeles. Capaz de generar imágenes de 1024 x 1024 píxeles, esta patente aplastó la miserable resolución de 256 x 256 píxeles de herramientas similares como DeepFaceLab. Incluso a principios de 2021, DeepFaceLab 2.0 solo soportaba un máximo de 448 x 448 píxeles.

A largo plazo, la tecnología deepfake de Disney podría reemplazar los métodos tradicionales de efectos especiales y acabar con la situación en la que unos segundos de imagen requieren meses de renderizado.

Los fans de Disney esperan con impaciencia esta tecnología. La serie de Star Wars «The Mandalorian», estrenada recientemente, aún no utilizaba la nueva función deepfake de megapíxeles, pero es de esperar que los vídeos deepfake de YouTube sobre las mismas escenas ya hayan logrado mejores resultados que los artistas CGI de Disney.

2021: Giras deepfake, directos y alquiler de rostros

Las noticias de este año empiezan con un vídeo deepfake de Tom Cruise. Este vídeo, presentado por primera vez en TikTok, era tan realista que solo se podían encontrar fallos con un estudio cuidadoso. El excelente efecto provocó una propagación viral, y el canal asociado «Deeptomcruise» acumuló rápidamente cientos de miles de seguidores y mucha atención por parte de los fans de Tom Cruise. El creador del canal fue el experto en efectos visuales Chris Umé, que declaró que cada vídeo le llevaba semanas de trabajo.

Poco después, la aplicación Wombo AI conquistó la red: con solo unos clics, se podía convertir cualquier foto de persona en un breve vídeo en el que la persona interpreta canciones famosas. Wombo AI aprende de vídeos grabados de artistas reales y luego combina el rostro de la foto con las expresiones del cantante original.

WOMBO AI es increíble, jaja

Disney también contrató a un conocido creador de contenido deepfake de YouTube, y corrieron rumores de que aparecerían más personajes deepfake en sus series y películas en el futuro. De hecho, la serie «The Book of Boba Fett», estrenada a finales de 2021, confirmó estas especulaciones.

Deepfakes en redes sociales y medios de comunicación

Además de Disney, el rostro de Bruce Willis apareció en un anuncio publicitario ruso. Una startup compró los derechos de su rostro real y utilizó la tecnología deepfake para convertirlo en contenido de marketing. Nvidia lanzó en 2021 Alias-Free GAN, una versión mejorada de StyleGAN2 que ofrece resultados más uniformes en escenas con cambios de ángulo. Meses después, apareció rápidamente la versión optimizada StyleGAN3.

El creador de DeepFaceLab presentó por primera vez en 2021 DeepFaceLive. Este programa puede intercambiar rostros en vídeos en tiempo real, una vez entrenado o al recibir modelos de IA preentrenados. Pero para obtener esta función de intercambio facial en tiempo real, el usuario necesita una tarjeta gráfica de gama alta capaz de ejecutar los últimos juegos AAA.

En 2021, los llamados modelos de difusión también igualaron por primera vez en calidad de imagen a las GAN, que hasta entonces habían sido las reinas. Aunque esta tecnología aún no se utilizaba para los deepfakes, se convirtió en la base de la herramienta de generación de imágenes GLIDE de OpenAI, lanzada a finales de 2021.

2022: GAN 3D, DALL-E 2 y el deepfake de Zelenski

En enero de este año aparecieron otras dos mejoras impresionantes de las GAN. Investigadores de IA de la Universidad de Tel Aviv mostraron una variante de StyleGAN2 que podía manipular fácilmente rostros en secuencias de vídeo cortas, por ejemplo, hacerlos sonreír o adelgazar al personaje, sin necesidad de entrenamiento adicional.

Investigadores de Nvidia y la Universidad de Stanford mostraron cómo implementar las Redes Antagónicas Generativas 3D eficientes con percepción geométrica (EG3D). Con este método, la IA puede generar imágenes 3D coherentes de personas (o gatitos) desde diferentes ángulos.

De forma correspondiente, las GAN 3D también pueden reconstruir un modelo 3D a partir de una imagen real. Por ello, las falsificaciones generadas por EG3D son aún más realistas, ya que los personajes se mantienen coherentes desde diferentes perspectivas.

En 2022, investigadores del Observatorio de Internet de Stanford descubrieron en un estudio de dos semanas más de 1000 perfiles falsos sospechosos en LinkedIn. Más de 70 empresas certificaron esos perfiles falsos como personas reales, la mayoría consideradas clientes potenciales interesantes. Si el contacto inicial tenía éxito, una persona real intervenía a tiempo para seguir comunicándose en nombre del personaje falso.

En el reciente conflicto entre Ucrania y Rusia, que ha atraído la atención mundial, también se produjo un hecho histórico con los deepfakes.

En el vídeo, el presidente ucraniano Zelenski falsificado pedía al pueblo que depusiera las armas. Aunque el vídeo tenía baja resolución y la falsificación era pobre, apenas tuvo efecto. Todavía no hay pruebas fehacientes de que se trate de un vídeo generado por IA, pero muchos medios y expertos creen que se trata casi con seguridad de un deepfake.

En abril de 2022, OpenAI presentó DALL-E 2, un sistema de IA capaz de generar imágenes a partir de descripciones de texto. Se esperaba que la versión completa del proyecto se lanzara en el verano de 2022.

DALL-E 2 y su modelo de difusión subyacente no se utilizaban para los deepfakes, y OpenAI prohibía expresamente generar rostros con esta técnica. Sin embargo, esta tecnología sin duda mejorará aún más la calidad final de las imágenes sintéticas en el futuro.

Conclusión

Cuando el inventor de las GAN, Goodfellow, presentó su trabajo por primera vez en 2014, seguramente no imaginaba que su creación impulsaría el rápido desarrollo de las imágenes falsificadas por IA. Hoy en día, él mismo advierte que en el futuro las personas ya no podrán dar por sentado que las imágenes y vídeos que circulan por internet son auténticos.

Al final, es posible que ni siquiera los algoritmos anti-deepfake más sofisticados sean capaces de detectar los últimos resultados de deepfake, lo que sin duda supondrá un cambio disruptivo en ámbitos como el social y el entretenimiento. El experto en deepfake Hao Li considera que esta suposición no es para nada exagerada: después de todo, una imagen no es más que píxeles con colores adecuados, y solo es cuestión de tiempo que la IA encuentre la disposición perfecta.

Además, con la rápida propagación de los deepfakes en plataformas como YouTube, Reface e Impressions, las imágenes falsificadas se han infiltrado rápidamente en nuestra vida cotidiana. En el pasado, los humanos aprendimos a obtener información y formar opiniones en una época oscura sin vídeos ni fotografías. Pero esta puerta hacia la luz parece estar siendo cerrada por las tecnologías emergentes. Goodfellow reflexionó: «Desde este punto de vista, la IA podría estar «cegando» los ojos de nuestra generación para observar el mundo.»